2024年AI安全五大热点回顾 | CAISP覆盖AI安全领域的一门认证

在ChatGPT推出两年后,生成式AI已成为网络安全领域的重要力量。2024年生成式AI技术的影响无处不在,从深伪欺诈到“影子AI”的风险,再到AI安全法规的出现和AI驱动的漏洞研究潜力。以下,我们将盘点过去一年AI与网络安全的五大热点话题。

深伪攻击与AI钓鱼袭击激增

目前,AI安全威胁的核心并非AI生成的恶意软件或流氓AI,而是通过AI生成的钓鱼诱饵和深伪技术实施的欺诈。这些攻击具有巨大的现实威胁。比如,香港某金融从业者因深伪视频会议被骗,转账高达2560万美元。类似的案例表明,深伪技术正在通过逼真的人脸仿真和声音模仿,威胁个人与企业的财务安全。

据安全公司iProov统计,2023年基于生物识别验证的“换脸”攻击激增了704%。深伪视频不仅欺骗了用户,也绕过了面部识别等生物特征验证系统。而AI驱动的商业电子邮件欺诈(BEC)也表现强劲,据VIPRE Security估计,AI生成的钓鱼邮件占商业欺诈诱饵的40%。

企业“影子AI”带来的数据泄露风险

企业内未经授权或监控的AI工具的使用(即“影子AI”)正在增长,带来了数据泄露风险。据Cyberhaven报告,2024年企业员工上传到生成式AI工具的敏感数据增长了485%,其中包括客户支持信息、源代码和研发数据。

尽管AI工具提升了生产力,但企业在安全培训和政策制定上的滞后引发了担忧。例如,美国众议院于2024年3月禁止员工使用微软Copilot,担心其导致敏感数据泄露。

LLM破解与APT组织的结合

2024年,针对大型语言模型(LLM)的攻击进一步演变,如Palo Alto Networks开发的“Deceptive Delight”方法仅需三次交互就能绕过安全限制。此外,知名APT组织如俄罗斯、朝鲜和中国的威胁行为者已被发现利用ChatGPT进行脚本生成、漏洞研究和目标侦察。

微软和OpenAI披露这些活动后迅速采取了关闭措施,且微软提议将LLM攻击方法纳入MITRE ATT&CK框架,反映了LLM威胁对网络安全生态的深远影响。

全球AI安全立法进程加速

2024年,全球AI法规进入新阶段。欧盟率先通过《AI法案》,以风险等级分类AI系统,禁止高风险应用,并设立相应的监管要求。而美国尚未推出类似的国家级法规,尽管其发布了针对关键基础设施的AI安全指南。此外,加州等州也尝试引入AI法规,但面临创新抑制的批评。

AI赋能网络安全的机遇

AI技术不仅是威胁,也为网络防御带来了全新可能性。例如,谷歌的AI驱动漏洞研究工具Big Sleep发现了SQLite数据库的漏洞,而其改进的OSS-Fuzz工具在开源项目中识别了26个新漏洞。

RSAC 2024会议也强调了AI对关键基础设施和国家安全防御的重要价值,从模式识别到自动化分析,AI正在帮助网络安全团队大幅提高效率。

生成式AI的崛起,让网络空间的攻防之战变得更加复杂。一方面,AI提升了攻击者的破坏力,另一方面,它也为安全从业者提供了前所未有的高效工具。这场博弈在未来几年只会愈发激烈,而全球各国的监管与产业力量也需紧密跟随其发展步伐。

CAISP

人工智能安全认证专家

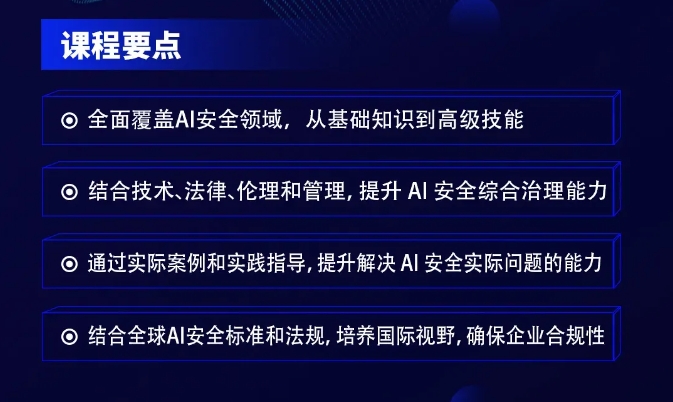

CAISP认证由云安全联盟大中华区发布,是一个全面覆盖AI安全领域的培训认证项目,从技术、法律、道德与伦理等多方面,提升AI安全综合治理能力;通过实际案例和实践指导,提升解决AI安全实际问题的能力。

该认证课程不仅填补了国内AI安全认证培训的空白,也为推动我国AI安全领域的技术创新和产业发展作出重要贡献。

承制CAISP培训班

在24年9月1日,由CSA官方举办的CAISP培训已有74位学员获得CAISP认证,成为中国首批CAISP持证专家。

承制科技作为CSA授权培训机构,在11月30日也成功举办了承制首期CAISP认证培训班,并且有不少学员已经申请并通过考试。

承制将继续提升CAISP教学服务质量,并预计在25年3月举办下一期CAISP直播培训班,现在报名可开通录播、习题供您提前预习。

CAISP学习对象

- AI行业相关人员:AI工程师与开发者、AI安全工程师、AI应用终端用户;

- 安全相关人员:安全研究员、合规与风险管理专员、网络安全从业者;

- 其他:政策制定者和监管机构、科技管理者、在校学生

CAISP公开课课程内容

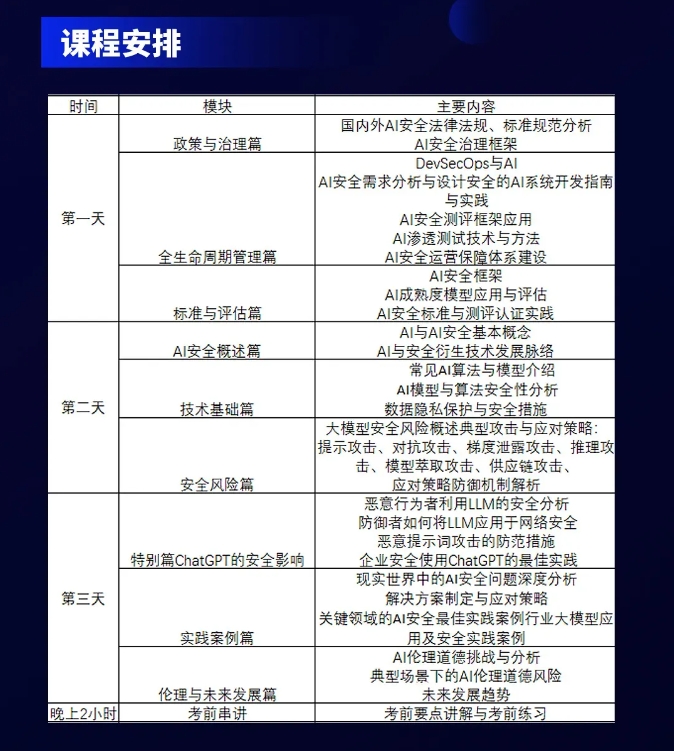

| 模块 | 培训内容 |

| AI安全概述篇 | AI与AI安全基本概念AI与安全衍生技术发展脉络 |

| 技术基础篇 | 常见AI算法与模型介绍AI模型与算法安全性分析数据隐私保护与安全措施 |

| 安全风险篇 | 大模型安全风险概述典型攻击与应对策略:提示攻击、对抗攻击、梯度泄露攻击、推理攻击、模型萃取攻击、供应链攻击、应对策略防御机制解析 |

| 政策与治理篇 | 国内外AI安全法律法规、标准规范分析AI安全治理框架 |

| 全生命周期管理篇 | DevSecOps与AIAI安全需求分析与设计安全的AI系统开发指南与实践AI安全测评框架应用AI渗透测试技术与方法AI安全运营保障体系建设 |

| 标准与评估篇 | AI安全框架AI成熟度模型应用与评估AI安全标准与测评认证实践 |

| 特别篇ChatGPT的安全影响 | 恶意行为者利用LLM的安全分析 防御者如何将LLM应用于网络安全恶意提示词攻击的防范措施 企业安全使用ChatGPT的最佳实践 |

| 实践案例篇 | 现实世界中的AI安全问题深度分析解决方案制定与应对策略关键领域的AI安全最佳实践案例行业大模型应用及安全实践案例 |

| 伦理与未来发展 | AI伦理道德挑战与分析典型场景下的AI伦理道德风险未来发展趋势 |

| 考前串讲 | 考前要点讲解与考前练习 |

CAISP证书样例